Các dấu hiệu nhận biết của một hình ảnh deepfake từng rất dễ phát hiện, nhưng AI sáng tạo đang khiến chúng ta đặt câu hỏi về mọi thứ chúng ta thấy và nghe hiện nay. Với mỗi mô hình AI mới được phát hành, các dấu hiệu nhận biết hình ảnh giả đang giảm dần và để tăng thêm sự nhầm lẫn, giờ đây bạn có thể tạo video deepfake, bản sao giọng nói của những người thân yêu của mình và tạo ra các bài báo giả chỉ trong vài giây.

Để tránh bị lừa bởi các trò chơi sâu AI, bạn nên biết loại nguy hiểm mà chúng gây ra.

Sự phát triển của Deepfakes

Deepfake cho thấy một người đang làm điều gì đó chưa từng xảy ra trong đời thực. Nó hoàn toàn giả tạo. Chúng tôi cười nhạo những trò đùa sâu khi chúng được chia sẻ trên internet dưới dạng meme hoặc trò đùa, nhưng rất ít người cảm thấy buồn cười khi chúng được sử dụng để đánh lừa chúng tôi.

Trước đây, deepfakes được tạo bằng cách chụp một bức ảnh hiện có và thay đổi nó trong một phần mềm chỉnh sửa hình ảnh như Photoshop. Nhưng điều làm nên sự khác biệt của AI deepfake là nó có thể được tạo từ đầu bằng cách sử dụng các thuật toán học sâu.

Từ điển Merriam-Webster định nghĩa deepfake là:

Một hình ảnh hoặc đoạn ghi âm đã bị thay đổi và thao túng một cách thuyết phục để xuyên tạc ai đó đang làm hoặc nói điều gì đó mà không thực sự được làm hoặc nói.

Nhưng với những tiến bộ trong công nghệ AI, định nghĩa này bắt đầu có vẻ lỗi thời. Với việc sử dụng các công cụ AI, deepfakes hiện bao gồm hình ảnh, văn bản, video và sao chép giọng nói. Đôi khi, cả bốn chế độ tạo AI đều được sử dụng cùng một lúc.

Bởi vì đây là một quy trình tự động, sử dụng cực kỳ nhanh và rẻ, nên đây là công cụ hoàn hảo để tạo ra các tác phẩm deepfake với tốc độ mà chúng tôi chưa từng thấy trước đây—tất cả mà không cần biết một điều gì về cách chỉnh sửa ảnh, video hoặc âm thanh .

Mối nguy hiểm lớn của AI Deepfakes

Một loạt trình tạo video AI đã tồn tại, cùng với nhiều trình tạo giọng nói AI. Sử dụng một mô hình ngôn ngữ lớn như GPT-4 và bạn có một công thức để tạo ra những tác phẩm sâu đáng tin cậy nhất mà chúng ta từng thấy trong lịch sử hiện đại cho đến nay.

Nhận thức được các loại deepfake AI khác nhau và cách chúng có thể được sử dụng để lừa bạn, là một cách để tránh bị lừa. Đây chỉ là một vài ví dụ nghiêm trọng về cách công nghệ deepfake AI gây ra mối đe dọa thực sự.

1. Trộm cắp danh tính AI

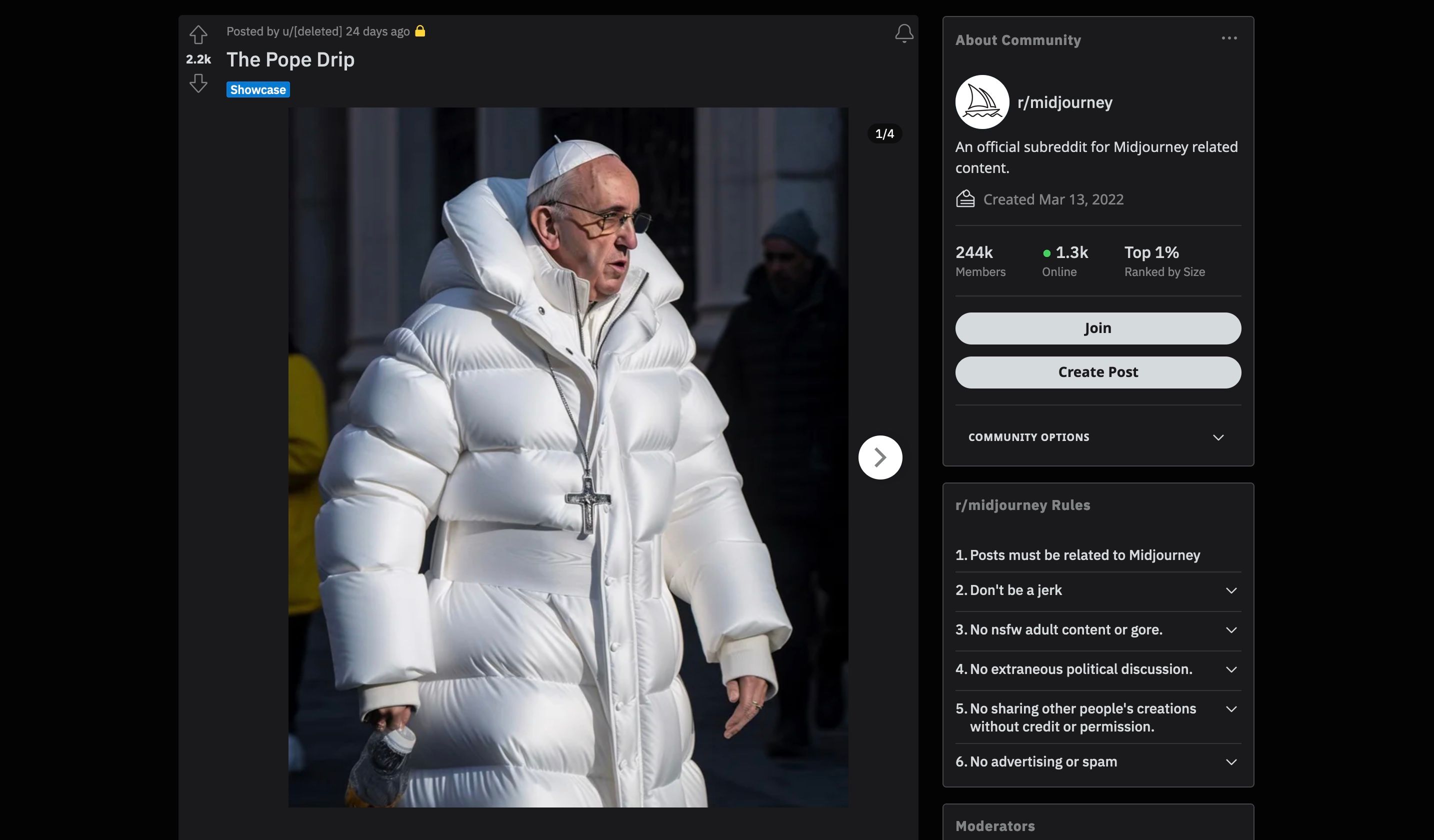

Bạn có thể đã nhìn thấy chúng. Trong số những tác phẩm sâu AI thực sự lan truyền đầu tiên lan truyền khắp thế giới là hình ảnh Donald Trump bị bắt và một trong số Giáo hoàng Francis trong chiếc áo khoác phao màu trắng.

Trong khi người ta có vẻ như đang tưởng tượng lại một cách ngây thơ về những gì một nhân vật tôn giáo nổi tiếng có thể mặc vào một ngày se lạnh ở Rome; hình ảnh còn lại, cho thấy một nhân vật chính trị trong một tình huống nghiêm trọng với luật pháp, có hậu quả lớn hơn nhiều nếu được coi là có thật.

Cho đến nay, mọi người chủ yếu nhắm mục tiêu đến những người nổi tiếng, nhân vật chính trị và các cá nhân nổi tiếng khác khi tạo ra các tác phẩm sâu AI. Điều này một phần là do các cá nhân nổi tiếng có rất nhiều ảnh của họ trên internet, điều này có thể giúp đào tạo người mẫu ngay từ đầu.

Trong trường hợp trình tạo hình ảnh AI như Midjourney — được sử dụng trong cả tác phẩm giả mạo sâu về Trump và Giáo hoàng — người dùng chỉ cần nhập văn bản mô tả những gì họ muốn xem. Có thể sử dụng các từ khóa để chỉ định phong cách nghệ thuật, chẳng hạn như ảnh chụp hoặc thuyết ảnh chân thực và kết quả có thể được tinh chỉnh bằng cách nâng cấp độ phân giải.

Bạn có thể dễ dàng học cách sử dụng Midjourney và tự kiểm tra điều này, nhưng vì những lý do đạo đức và pháp lý rõ ràng, bạn nên tránh đăng những hình ảnh này một cách công khai.

Thật không may, là một người bình thường, không nổi tiếng cũng sẽ không đảm bảo rằng bạn an toàn trước các trò chơi sâu AI.

Vấn đề nằm ở một tính năng chính được cung cấp bởi các trình tạo hình ảnh AI: khả năng tải lên hình ảnh của riêng bạn và thao tác với AI. Và một công cụ như Outpainting trong DALL-E 2 có thể mở rộng hình ảnh hiện có ra ngoài đường viền của nó bằng cách nhập lời nhắc văn bản và mô tả những gì bạn muốn tạo.

Nếu ai đó làm điều này với ảnh của bạn, thì mối nguy hiểm có thể lớn hơn đáng kể so với việc giả mạo sâu Giáo hoàng trong chiếc áo khoác trắng—họ có thể sử dụng nó ở bất cứ đâu, giả vờ là bạn. Mặc dù hầu hết mọi người thường sử dụng AI với mục đích tốt, nhưng có rất ít hạn chế ngăn mọi người sử dụng nó để gây hại, đặc biệt là trong các trường hợp đánh cắp danh tính.

2. Lừa đảo nhân bản giọng nói Deepfake

Với sự trợ giúp của AI, deepfakes đã vượt qua ranh giới mà hầu hết chúng ta chưa chuẩn bị: nhân bản giọng nói giả. Chỉ với một lượng nhỏ âm thanh gốc—có thể từ video TikTok bạn từng đăng hoặc video YouTube mà bạn xuất hiện—mô hình AI có thể sao chép giọng nói duy nhất của bạn.

Thật kỳ lạ và đáng sợ khi tưởng tượng nhận được một cuộc điện thoại giống như một thành viên trong gia đình, bạn bè hoặc đồng nghiệp. Bản sao giọng nói Deepfake là một mối lo ngại nghiêm trọng đến mức Ủy ban Thương mại Liên bang (FTC) đã đưa ra cảnh báo về nó.

Đừng tin vào giọng nói. Gọi cho người được cho là đã liên lạc với bạn và xác minh câu chuyện. Sử dụng số điện thoại mà bạn biết là của họ. Nếu bạn không thể liên lạc với người thân của mình, hãy cố gắng liên lạc với họ thông qua một thành viên khác trong gia đình hoặc bạn bè của họ.

Tờ Washington Post đưa tin về trường hợp một cặp vợ chồng ở độ tuổi 70 nhận được cuộc điện thoại từ một người giống hệt cháu trai của họ. Anh ta đang ở trong tù và cần tiền gấp để được tại ngoại. Không còn lý do nào khác để nghi ngờ họ đang nói chuyện với ai, họ đã tiếp tục và giao tiền cho kẻ lừa đảo.

Không chỉ thế hệ cũ gặp rủi ro, The Guardian đã báo cáo một ví dụ khác về một giám đốc ngân hàng đã phê duyệt giao dịch trị giá 35 triệu đô la sau một loạt “cuộc gọi giả” từ một người mà họ tin là giám đốc ngân hàng.

3. Tin giả được sản xuất hàng loạt

Các mô hình ngôn ngữ lớn, chẳng hạn như ChatGPT, rất rất giỏi trong việc tạo ra văn bản nghe giống tiếng người và chúng tôi hiện không có công cụ hiệu quả để phát hiện sự khác biệt. Nếu rơi vào tay kẻ xấu, tin tức giả mạo và thuyết âm mưu sẽ được sản xuất với giá rẻ và mất nhiều thời gian hơn để vạch trần.

Tất nhiên, lan truyền thông tin sai lệch không phải là điều gì mới, nhưng một bài báo nghiên cứu được xuất bản trên arXiv vào tháng 1 năm 2023 giải thích rằng vấn đề nằm ở chỗ việc mở rộng quy mô đầu ra bằng các công cụ AI dễ dàng như thế nào. Họ gọi đó là “các chiến dịch gây ảnh hưởng do AI tạo ra”, chẳng hạn như họ cho rằng có thể được các chính trị gia sử dụng để thuê ngoài các chiến dịch chính trị của họ.

Việc kết hợp nhiều nguồn do AI tạo ra sẽ tạo ra một deepfake cấp cao. Ví dụ: một mô hình AI có thể tạo ra một câu chuyện tin tức được viết hay và thuyết phục để đi cùng với hình ảnh giả mạo về việc Donald Trump bị bắt. Điều này mang lại cho nó tính hợp pháp hơn so với việc hình ảnh được chia sẻ riêng.

Tin tức giả mạo không chỉ giới hạn ở hình ảnh và chữ viết, sự phát triển trong thế hệ video AI có nghĩa là chúng ta đang thấy nhiều video deepfake hơn được cắt xén. Đây là một trong những bức ảnh của Robert Downey Jr. được ghép vào một video của Elon Musk, được đăng bởi kênh YouTube Deepfakery.

Tạo một deepfake có thể đơn giản như tải xuống một ứng dụng. Bạn có thể sử dụng ứng dụng như TokkingHeads để biến ảnh tĩnh thành hình đại diện động, cho phép bạn tải lên hình ảnh và âm thanh của riêng mình để làm cho người đó có vẻ như đang nói chuyện.

Phần lớn, nó mang tính giải trí và vui vẻ, nhưng cũng có khả năng gây rắc rối. Nó cho chúng ta thấy việc sử dụng hình ảnh của bất kỳ ai để làm cho người đó có vẻ như thốt ra những lời mà họ chưa bao giờ nói ra dễ dàng như thế nào.

Đừng để bị lừa bởi AI Deepfake

Deepfakes có thể được triển khai nhanh chóng với chi phí rất thấp và yêu cầu ít về chuyên môn hoặc sức mạnh tính toán. Chúng có thể ở dạng hình ảnh được tạo, bản sao giọng nói hoặc kết hợp hình ảnh, âm thanh và văn bản do AI tạo.

Trước đây, việc tạo ra một tác phẩm deepfake khó khăn và tốn nhiều công sức hơn rất nhiều, nhưng giờ đây, với rất nhiều ứng dụng AI ngoài kia, hầu như bất kỳ ai cũng có quyền truy cập vào các công cụ được sử dụng để tạo ra các tác phẩm deepfake. Khi công nghệ deepfake AI ngày càng phát triển tiên tiến, bạn nên theo dõi sát sao những nguy hiểm mà nó gây ra.